Google amplia parceria com Intel para reforçar CPUs Xeon em data centers de IA

Por Equipe Portal Tech & Negócios

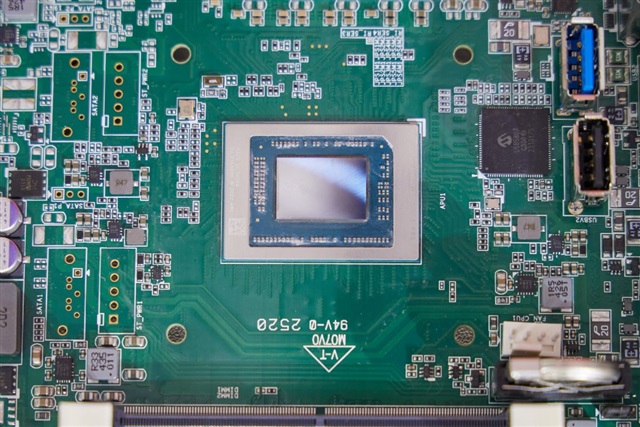

A corrida por infraestrutura de IA entrou em uma fase em que CPUs voltaram a ser um gargalo estratégico, não apenas GPUs. Nesse contexto, o Google anunciou a ampliação da colaboração com a Intel para aumentar a implantação de processadores Intel Xeon em seus data centers de IA na nuvem.

Essa movimentação sinaliza uma leitura pragmática do mercado: com a demanda por treinamento e inferência crescendo rapidamente, manter capacidade disponível exige planejamento de supply chain e diversificação de componentes. Ao fortalecer o fornecimento de CPUs, o Google reduz risco operacional (capacidade e previsibilidade de entrega) e melhora a elasticidade da plataforma para cargas de trabalho de IA que dependem fortemente de host CPU, memória e rede.

O que muda com a expansão entre Google e Intel

A ampliação do acordo busca acelerar a adoção de CPUs Xeon no backbone de IA do Google Cloud, refletindo uma tendência mais ampla: clusters de IA modernos não são “só aceleradores”. Eles exigem uma base robusta de computação geral para orquestração, pré e pós-processamento de dados, controle de jobs e serviços adjacentes.

Pontos-chave do anúncio e do contexto de mercado:

- Mais CPUs Intel Xeon em data centers de IA do Google Cloud.

- Resposta direta ao crescimento acelerado da demanda por CPUs dentro de pilhas de IA.

- Ênfase em segurança de cadeia de suprimentos, garantindo volume e previsibilidade.

Por que CPUs estão voltando ao centro da infraestrutura de IA

Embora aceleradores (como GPUs e ASICs) sejam o destaque, as CPUs seguem críticas em vários trechos do pipeline:

- Orquestração e controle do cluster (schedulers, serviços, monitoramento e controle de recursos).

- Ingestão e preparação de dados, incluindo ETL e tokenização.

- Pós-processamento e serviços de aplicação, como roteamento, caching e camadas de segurança.

- Balanceamento entre custo e desempenho: nem toda tarefa precisa rodar em acelerador.

Na prática, quando o volume de cargas de IA cresce, cresce também a necessidade de CPUs para manter a operação eficiente. Isso torna acordos de fornecimento e padronização de plataforma uma vantagem competitiva para provedores de nuvem.

Impactos: oportunidades para ASICs e para startups

A notícia também aponta um efeito colateral relevante: ao mesmo tempo em que CPUs ganham reforço, o ecossistema abre mais espaço para especialização.

Tendências e inovações que ganham força

- Arquiteturas híbridas: combinação de CPUs + aceleradores (incluindo ASICs) como padrão de data center de IA.

- Customização por workload: mais incentivos para chips e placas otimizados para inferência, redes, armazenamento e compressão.

- Eficiência e custo total (TCO) como métrica dominante: desempenho por watt e por dólar passa a orientar decisões.

Onde entram startups

Com grandes players assegurando capacidade de CPU em escala, surgem lacunas para empresas menores atacarem nichos:

- ASICs e aceleradores especializados para tarefas específicas (inferência, recomendação, busca, visão computacional).

- Software de orquestração e otimização que reduz o uso de CPU/accelerator por requisição.

- Soluções de observabilidade e governança para cargas de IA (custo, latência, rastreabilidade de execução).

O que observar a seguir

O movimento de Google e Intel tende a acelerar uma dinâmica de mercado em que infraestrutura de IA é decidida por acesso a componentes, integração e capacidade de entrega. Para empresas de tecnologia e negócios, a leitura é clara: o diferencial não está apenas em “ter o melhor modelo”, mas em operar uma plataforma com infraestrutura de IA escalável, previsível e economicamente sustentável.